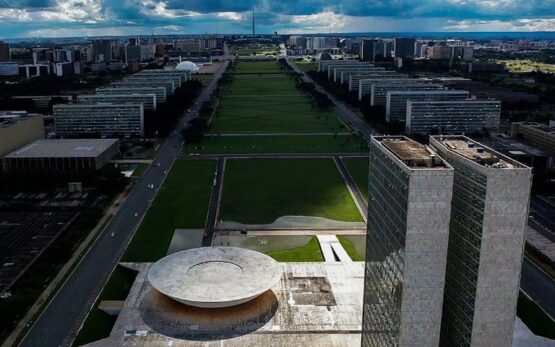

Vigilância a serviço de quem?

Foto: Netflix/ Divulgação

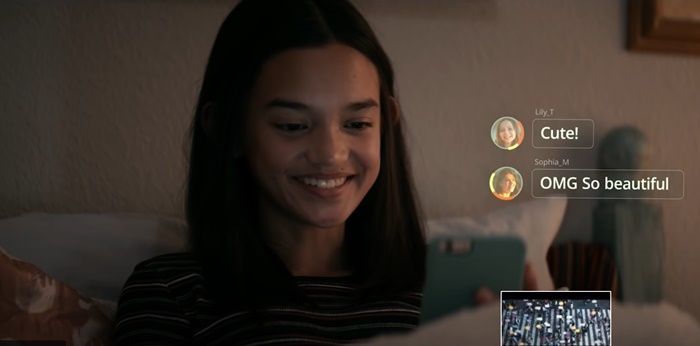

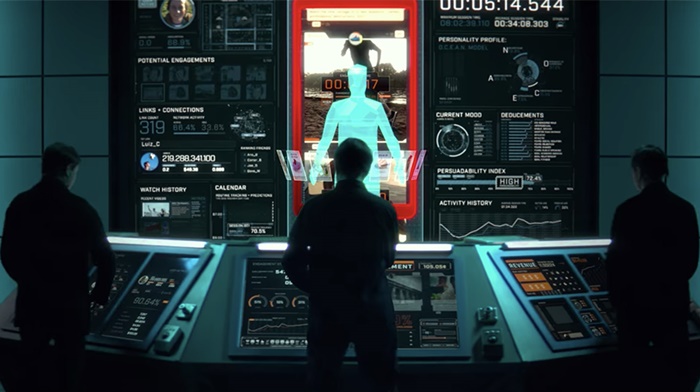

Sistemas democráticos ao redor do mundo estão lidando com dificuldades relacionadas à desinformação das fake news e das máquinas de manipulação de pessoas através de seus perfis de uso de redes, chama-se isso de big data

Foto: Netflix/ Divulgação

Em janeiro foi inaugurado, em São Paulo, o Laboratório de Identificação Biométrica – Facial e Digital –, na sede do Instituto de Identificação Ricardo Gumbleton Daunt (IIRGD). Seu uso se dá principalmente em investigações policiais. Apesar de não funcionar em tempo real, faz o cruzamento das imagens do suspeito, captadas, por exemplo, por câmeras de monitoramento no local do crime, com a base de dados da Secretaria de Segurança Pública.

Outra inteligência artificial em expansão em terra brasilis é o Córtex, que o Ministério da Justiça está expandindo como uma das maiores ferramentas de vigilância do país. Trata-se de uma tecnologia que usa a leitura de placas de veículos por milhares de câmeras viárias espalhadas por rodovias, pontes, túneis, ruas e avenidas, país afora, para rastrear alvos móveis em tempo real.

Informações sigilosas e sensíveis dos cidadãos

O Córtex também possui acesso a diversos bancos de dados, inclusive com informações sigilosas e sensíveis de cidadãos e empresas, como a Relação Anual de Informações Sociais (Rais), do Ministério da Economia. Oficiais militares podem ter acesso a dados cadastrais e trabalhistas de todas as empresas, sobre seus funcionários, incluindo RG, CPF, endereço, dependentes e até salário e cargo.

Nos Estados Unidos, o uso dessas tecnologias vem sendo contestado. Em caso emblemático, um cidadão negro norte-americano chamado Steve Talley, há alguns anos, saiu de sua casa para verificar seu veículo estacionado na rua, quando foi golpeado sem que pudesse saber quem era. Chegou a pedir socorro e gritou pela polícia, mas para sua surpresa a violência partia justamente desse braço armado do Estado.

Foto: Netflix/ Divulgação

“O algoritmo, inclusive no reconhecimento facial, é usado para os mais variados interesses”

Foto: Netflix/ Divulgação

Um sistema de reconhecimento facial havia identificado seu rosto como sendo o de um suspeito que aparecia em câmeras de bancos recentemente assaltados, o que motivou a atitude dos agentes policiais e também a sua prisão. Mas ele possuía um forte álibi, com o qual conseguiu provar sua inocência, mas não sem antes passar meses encarcerado, e ter que, após esse período, levar mais de um ano para regularizar seu nome.

No Brasil, o uso do Córtex já é contestado. O sistema do Ministério da Justiça caminhava a passos largos, sem debate algum junto à sociedade, e sofreu alguns reveses na Suprema Corte. Era praticamente desconhecido até julho, quando a existência de um dossiê de inteligência contra policiais e professores ligados a movimentos antifascistas produzido no ministério veio a público. O diretor de Inteligência da Seopi, Gilson Libório, um dos responsáveis diretos tanto pelo Córtex quanto pelo dossiê secreto, foi exonerado e passou a ser investigado pelo Ministério Público Federal (MPF).

Em decisão plenária, os ministros do STF decidiram mandar a pasta da Justiça suspender a produção de dossiês por motivações políticas. Contudo, o Córtex continua em expansão. Veja, o sistema já foi usado nas cinco cidades-sede da Copa América no ano passado, nas eleições e até no Enem de 2018.

Marco Civil da Internet

Aqui, o reconhecimento facial já é usado pelas gigantes da internet, como Facebook e Google. O Marco Civil da Internet, oficialmente chamado de Lei n° 12.965/2014, é a lei que regula o uso da Internet no Brasil por meio da previsão de princípios, garantias, direitos e deveres para quem usa a rede, bem como da determinação de diretrizes para a atuação do Estado. Apesar disso, ainda há uma série de escândalos e disputas judiciais associadas a práticas duvidosas no uso de informações sensíveis, como o reconhecimento facial, utilizando os algoritmos de grandes como Alphabet (detentora do Google), Facebook, Amazon, Microsoft e Apple, governos e instituições internacionais.

O algoritmo, inclusive no reconhecimento facial, é usado para os mais variados interesses. Importante: Estão utilizando “algoritmo” como forma de generalização para todos os padrões algorítmicos que regem o sistema de programação ou inteligência artificial (IA) das redes, que basicamente cria as “bolhas” (grupos de pessoas) e seleciona quem recebe qual conteúdo a partir da coleta de big data.

Manipulação, fake news e grupos de ódio

Foto: Netflix/ Divulgação

“As interferências perpetradas por empresas no cenário sociopolítico impactam diretamente no aumento dos discursos de ódio”

Foto: Netflix/ Divulgação

Sistemas democráticos ao redor do mundo estão lidando com dificuldades relacionadas à desinformação das fake news e das máquinas de manipulação de pessoas através de seus perfis de uso de redes, chama-se isso de big data. Note que há menos de uma década, no Quênia, a Cambridge Analytica realizou experiências de manipulação de redes sociais para fins eleitorais ou projetos de desestabilização política. A empresa atuou nesse país nas eleições de 2013 e de 2017, contratada pelo presidente Uhuru Kenyatta, que se elegeu em ambas as votações.

Sobre esse assunto, indico o documentário, O Dilema das Redes, que está disponível na Netflix.

As interferências perpetradas por empresas no cenário sociopolítico impactam diretamente no aumento dos discursos de ódio. Isso porque fomentam o aumento de uma ideia de que há um inimigo a ser combatido, pois assim se lucra mais com acessos e compartilhamentos. “Toda vez em que vamos parar no trending topics as empresas vão lá e anunciam. Eles estão lucrando com a exploração do racismo e da misoginia”, afirma Djamila Ribeiro, em live da Vogue Brasil, abordando sua ação judicial contra a rede social Twitter.

Embora persista uma forte negação institucional sobre a existência de racismo e outras opressões no Brasil, basta que se navegue pelas principais redes sociais para constatar inúmeras manifestações racistas sendo disseminadas nesse ambiente. E é neste contexto que a tecnologia do reconhecimento facial em nome da segurança pública tem sido pensada e implementada.

Mais poder punitivo do Estado

Não é preciso muito esforço intelectivo para saber que essas novas tecnologias irão aumentar o poder punitivo do Estado. Isso porque com mais ferramentas de controle, maior esse poder. Isso seria ruim, porque nem sempre essas ferramentas de controle levam ao autor de um delito, mas a um inocente, vide o já mencionado cidadão negro norte-americano preso injustamente nos EUA. Em um país como o nosso, em que mais de 70% das pessoas encarceradas são negras, é latente a possibilidade de maior criminalização dessa minoria social.

Tendo em vista que essas tecnologias aparentemente trazem muitos benefícios, e de fato trazem, precisam ser vistas não como vilãs, mas com o cuidado necessário para que não sejam utilizadas para acabar com o estado democrático de direito, que tem como premissa a preservação da inocência de alguém até que se prove o contrário. Outra premissa desse tipo de organização política é o acesso a informações de maneira livre, desde que essas informações não tenham conteúdos maliciosos e não estejam “viciadas” em ser direcionadas para perfis de pessoas mais suscetíveis à desinformação pregada por fake news. Por isso, insta que se observe bem a forma de utilização da IA e do big data algoritmo.

É necessário estarmos vigilantes quanto a impulsos autoritários (tipo dossiês de servidores públicos antifascistas feitos pelo Ministério da Justiça). Isso porque perseguições políticas se utilizando do poder estatal não podem ser toleradas em uma democracia.

Como demonstrado, a tecnologia é atravessada pelas hierarquias presentes na sociedade. Há riscos relevantes para os direitos e garantias fundamentais de um estado democrático de direito. A tecnologia não é neutra. Por isso requer reflexão, informação e muito cuidado com as informações sensíveis de cidadãos, empresas e governos.

Ritchele Luis Vergara da Fontoura é estudante de Direito na Universidade Federal do Rio Grande do Sul (Ufrgs) e servidor municipal Prefeitura de Porto Alegre (RS) – @negoritchie